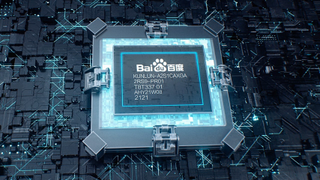

百度今年6月将其半导体设计业务剥离为一家独立公司动态数据中心.昆仑晶片科技有限公司(Kunlun Chip Technology Co.)对其业务的估值约为20亿美元

昆仑芯片是中国高科技巨头百度的全资子公司,本周表示该公司已开始量产用于人工智能应用的昆仑II处理器。新AI芯片基于第二代XPU微架构,采用7nm制程技术,有望提供比之前的2 - 3倍的性能。

为云、边缘和自动驾驶汽车应用而设计的第一代昆仑K200处理器,三年前宣布提供约256 INT8 TOPS性能,约64 TOPS INT/FP16性能,以及16 INT/FP32 TOPS性能,功率为150瓦。

如果Kunlun II芯片的性能比它的前辈高2-3倍的说法是正确的,那么新的芯片可以提供512到768 INT8 TOPS, 128 - 192 INT/FP16 TOPS和32 - 48 INT/FP32 TOPS吞吐量。相比之下,英伟达的A100提供了19.5 FP32 TFLOPS和624/1248(稀疏)INT8 TOPS。就数据而言,昆仑二代至少在人工智能计算方面可以与英伟达的A100等处理器竞争。

百度昆仑二代的相对业绩

| 百度昆仑 | 百度昆仑二世 | 英伟达A100 | |

| INT8 | 256顶 | 512 ~ 768顶 | 624/1248 *上衣 |

| INT / FP16 | 64顶 | 128 ~ 192顶 | * TFLOPS (bfloat16/FP16张量) |

| 张量浮点32 (TF32) | - | - | 156/312 * TFLOPS |

| INT / FP32 | 16个上衣 | 32 ~ 48顶 | 19.5 TFLOPS |

| FP64张量的核心 | - | - | 19.5 TFLOPS |

| FP64 | - | - | 9.7 TFLOPS |

*与稀疏

虽然比较不同的人工智能平台的峰值性能并不总是一件好事,因为很多事情都依赖于软件,但这些数据可以让我们对第二代昆仑人工智能处理器的性能有一些了解。

百度早在2011年就开始着手昆仑人工智能芯片项目。最初,该公司使用fpga研究和模拟其多小核XPU微架构,但在2018年,该公司最终使用三星Foundry的一种14纳米制造工艺(大概是14LPP)制造了一种专用硅。该芯片配备了2个8GB的HBM内存包,峰值带宽为512GB/s。

到目前为止,第一代昆仑汽车已被用于百度'c云数据中心、该公司的Apolong自动驾驶汽车平台以及其他一些应用。